Amazon Data Firehose は、以前は Amazon Kinesis Data Firehose として知られていました

翻訳は機械翻訳により提供されています。提供された翻訳内容と英語版の間で齟齬、不一致または矛盾がある場合、英語版が優先します。

Amazon Data Firehose とは

Amazon Data Firehose は、Amazon Simple Storage Service (Amazon S3)、Amazon Redshift、Amazon OpenSearch Service、Amazon OpenSearch Serverless、Splunk、カスタム HTTP エンドポイント、または Datadog、Dynatrace、 LogicMonitorMongoDB、New Relic、Coralogix、Elastic など、サポートされているサードパーティーサービスプロバイダーが所有する HTTP エンドポイントなどの宛先にリアルタイムストリーミングデータを

AWS ビッグデータソリューションの詳細については、「AWS でのビッグデータ

注記

AWS Amazon MSK 向けの最新のストリーミングデータソリューション

主なコンセプト

Amazon Data Firehose の使用を開始すると、以下の概念を理解しておくと利点があります。

- Firehose ストリーム

-

Amazon Data Firehose の基盤となるエンティティ。Amazon Data Firehose を使用するには、Firehose ストリームを作成し、そのストリームにデータを送信します。詳細については、「Firehose ストリームの作成」および「Firehose ストリームへのデータの送信」を参照してください。

- record

-

データプロデューサーが Firehose ストリームに送信する対象のデータ。レコードのサイズは最大 1000 KB です。

- データプロデューサー

-

プロデューサーは Firehose ストリームにレコードを送信します。例えば、Firehose ストリームにログデータを送信するウェブサーバーはデータプロデューサーです。既存の Kinesis データストリームからデータを自動的に読み取り、宛先にロードするように Firehose ストリームを設定することもできます。詳細については、「Firehose ストリームへのデータの送信」を参照してください。

- バッファサイズおよびバッファの間隔

-

Amazon Data Firehose は、受信するストリーミングデータを特定のサイズまたは一定期間バッファしてから、送信先に配信します。 Buffer Size は MBs 単位で、 Buffer Interval は秒単位です。

データフロー

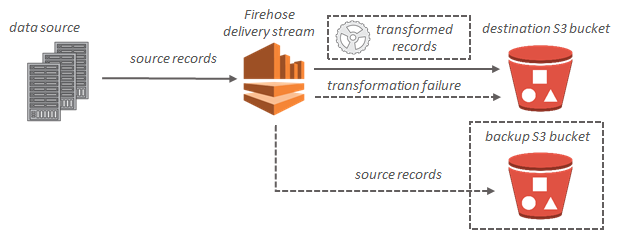

Amazon S3 の送信先の場合、ストリーミングデータは S3 バケットに配信されます。データ変換が有効な場合は、オプションで、送信元データを別の Amazon S3 バケットにバックアップすることもできます。

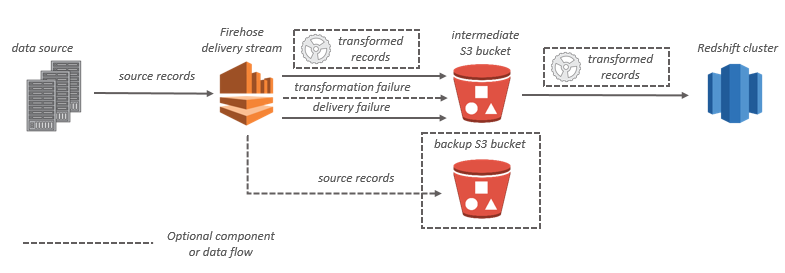

Amazon Redshift の送信先の場合、ストリーミングデータは S3 バケットに配信されます。次に、Amazon Data Firehose は Amazon Redshift COPY コマンドを発行して、S3 バケットから Amazon Redshift クラスターにデータをロードします。データ変換が有効な場合は、オプションで、送信元データを別の Amazon S3 バケットにバックアップすることもできます。

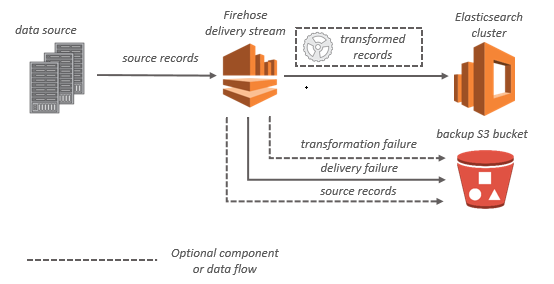

OpenSearch サービス送信先の場合、ストリーミングデータはサービスクラスターに OpenSearch配信され、オプションで S3 バケットに同時にバックアップできます。

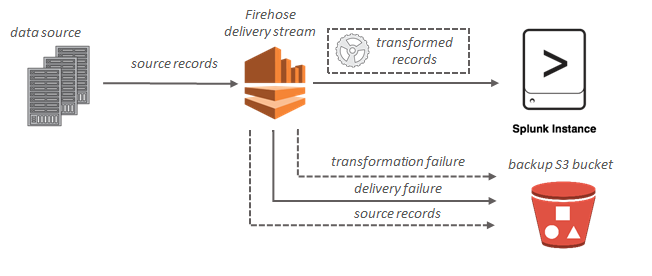

Splunk の送信先を使用する場合、ストリーミングデータは Splunk に配信され、オプションで、配信と同時に S3 バケットにバックアップすることもできます。