Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Schritt 4: Analysieren eines Bildes mit Ihrem Modell

Sie analysieren ein Bild, indem Sie den aufrufen. DetectCustomLabelsAPI In diesem Schritt verwenden Sie den Befehl detect-custom-labels AWS Command Line Interface (AWS CLI), um ein Beispielbild zu analysieren. Sie erhalten den AWS CLI Befehl von der Amazon Rekognition Custom Labels-Konsole. Die Konsole konfiguriert den AWS CLI Befehl so, dass er Ihr Modell verwendet. Sie müssen nur ein Bild bereitstellen, das in einem Amazon-S3-Bucket gespeichert ist. Dieses Thema enthält ein Bild, das Sie für jedes Beispielprojekt verwenden können.

Anmerkung

Die Konsole bietet auch Python-Beispielcode.

Die Ausgabe von detect-custom-labels umfasst eine Liste der im Bild gefundenen Labels, Begrenzungsrahmen (wenn das Modell Objektpositionen findet) und das Vertrauen, das das Modell in die Genauigkeit der Vorhersagen hat.

Weitere Informationen finden Sie unter Analysieren eines Bildes mit einem trainierten Modell.

So analysieren Sie ein Bild (Konsole)

-

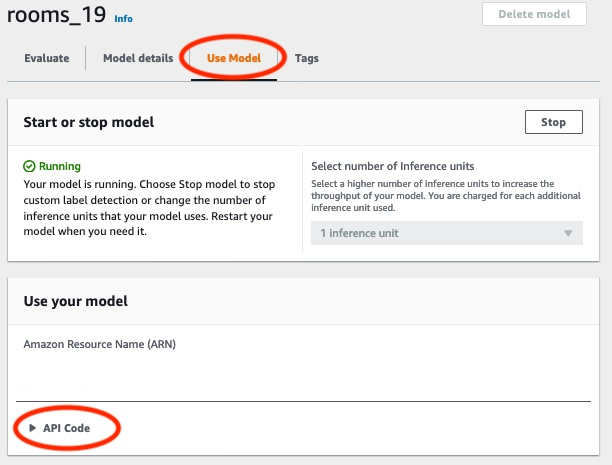

<textobject><phrase>Der Modellstatus wird als Wird ausgeführt angezeigt, mit der Schaltfläche Stopp wird das laufende Modell angehalten. </phrase></textobject>

Wenn Sie es noch nicht getan haben, richten Sie das ein AWS CLI. Detaillierte Anweisungen finden Sie unter Schritt 4: Richten Sie das und ein AWS CLIAWS SDKs.

-

Wenn Sie es noch nicht getan haben, starten Sie Ihr Modell. Weitere Informationen finden Sie unter Schritt 3: Starten Ihres Modells.

-

Wählen Sie die Registerkarte Modell verwenden und wählen Sie dann APICode aus. Im unten abgebildeten Modellstatusfenster wird das Modell als „Wird ausgeführt“ angezeigt. Es gibt eine Stopp-Schaltfläche, um das laufende Modell zu stoppen, und eine Option zum Anzeigen vonAPI.

Wählen Sie AWSCLIden Befehl.

-

Kopieren Sie im Abschnitt Bild analysieren den AWS CLI Befehl, der aufgerufen wird

detect-custom-labels. Die folgende Abbildung der Rekognition-Konsole zeigt den Abschnitt „Bild analysieren“ mit dem AWS CLI Befehl zur Erkennung benutzerdefinierter Labels auf einem Bild mithilfe eines Machine-Learning-Modells sowie Anweisungen zum Starten des Modells und zur Bereitstellung von Bilddetails.

-

Laden Sie ein Beispielbild in einen Amazon-S3-Bucket hoch. Detaillierte Anweisungen finden Sie unter Ein Beispielbild erhalten.

-

Geben Sie in der Befehlszeile den AWS CLI Befehl ein, den Sie im vorherigen Schritt kopiert haben. Es sollte wie das folgende Beispiel aussehen.

Der Wert von

--project-version-arnsollte Amazon Resource Name (ARN) Ihres Modells sein. Der Wert von--regionsollte der AWS Region entsprechen, in der Sie das Modell erstellt haben.Ändern Sie

MY_BUCKETundPATH_TO_MY_IMAGEin den Amazon-S3-Bucket und das Bild, das Sie im vorherigen Schritt verwendet haben.Wenn Sie das custom-labels-accessProfil zum Abrufen von Anmeldeinformationen verwenden, fügen Sie den

--profile custom-labels-accessParameter hinzu.aws rekognition detect-custom-labels \ --project-version-arn "model_arn" \ --image '{"S3Object": {"Bucket": "MY_BUCKET","Name": "PATH_TO_MY_IMAGE"}}' \ --regionus-east-1\ --profile custom-labels-accessWenn das Modell Objekte, Szenen und Konzepte findet, sollte die JSON Ausgabe des AWS CLI Befehls etwa wie folgt aussehen.

Nameist der Name der Bezeichnung auf Bildebene, die das Modell gefunden hat.Confidence(0-100) ist das Vertrauen des Modells in die Genauigkeit der Vorhersage.{ "CustomLabels": [ { "Name": "living_space", "Confidence": 83.41299819946289 } ] }Wenn das Modell Objektpositionen oder Marken findet, werden mit Labeln versehene Begrenzungsrahmen zurückgegeben.

BoundingBoxenthält die Position eines Rahmens, den das Objekt umgibt.Nameist das Objekt, das das Modell in dem Begrenzungsrahmen gefunden hat.Confidenceist die Gewissheit des Modells, dass der Begrenzungsrahmen das Objekt enthält.{ "CustomLabels": [ { "Name": "textract", "Confidence": 87.7729721069336, "Geometry": { "BoundingBox": { "Width": 0.198987677693367, "Height": 0.31296101212501526, "Left": 0.07924537360668182, "Top": 0.4037395715713501 } } } ] } -

Verwenden Sie das Modell weiterhin, um andere Bilder zu analysieren. Stoppen Sie das Modell, wenn Sie es nicht mehr verwenden. Weitere Informationen finden Sie unter Schritt 5: Stoppen Ihres Modells.

Ein Beispielbild erhalten

Sie können die folgenden Bilder für den DetectCustomLabels-Vorgang verwenden. Für jedes Projekt gibt es ein Bild. Um die Bilder zu verwenden, laden Sie sie in einen S3-Bucket hoch.

So verwenden Sie ein Beispielbild

-

Klicken Sie mit der rechten Maustaste auf das folgende Bild, das dem Beispielprojekt entspricht, das Sie verwenden. Wählen Sie dann Bild speichern, um das Bild auf Ihrem Computer zu speichern. Je nachdem, welchen Browser Sie verwenden, kann die Menüoption unterschiedlich sein.

-

Laden Sie das Bild in einen Amazon S3 S3-Bucket hoch, der Ihrem AWS Konto gehört und sich in derselben AWS Region befindet, in der Sie Amazon Rekognition Custom Labels verwenden.

Weitere Anleitungen finden Sie unter Upload eines Objekts in Amazon S3 im Benutzerhandbuch für Amazon Simple Storage Service.

Bildklassifizierung

Klassifizierung mit mehreren Labels

Erkennung von Marken

Lokalisierung von Objekten