Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

Creación de canalizaciones de transmisión multimedia de Amazon Chime SDK

La canalización de transmisión multimedia de Chime debe pertenecer a la misma AWS cuenta que la reunión del SDK de Amazon Chime. Para crear la canalización de transmisión multimedia del SDK de Amazon Chime, debe llamar a CreateMediaStreamPipelineAPI y especificando una fuente y un receptor.

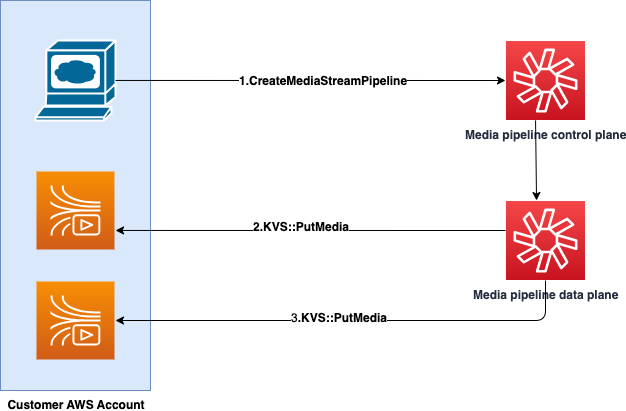

En el siguiente diagrama, se muestra la arquitectura de una canalización de transmisión multimedia de Amazon Chime SDK. Los números del diagrama corresponden al texto numerado que aparece a continuación.

En el diagrama:

-

Llame a la API

CreateMediaStreamPipeline. En la solicitud, especifique las fuentes y los receptores de las transmisiones, ya desee capturar audio individual, audio mixto o ambos. Incluya el ARN de su grupo KVS en la solicitud.-

La matriz de fuentes consta de las letras

SourceTypeySourceArn. Debe utilizar elChimeSdkMeeting SourceType. ElSourceArnes el ARN de laChimeSdkMeeting. -

La matriz de sumideros se compone de

SinkType,SinkArn,ReservedStreamCapacityyMediaStreamType. Solo ofrecemos compatibilidad con elKinesisVideoStreamPoolSinkType. ElSinkArnes el ARN de laKinesisVideoStreamPool. ElMediaStreamTypecontrola el tipo de contenido multimedia que se transmite al sumidero, ya seaMixedAudiooIndividualAudio.ReservedStreamCapacityestablece el número de transmisiones asignadas alMediaStreamTypedesde elKinesisVideoStreamPool.-

Si desea transmitir

IndividualAudioyMixedAudio, cree dos objetos receptores en la matriz deSinks, uno paraIndividualAudioy otro paraMixedAudio. ElSinkArn(el ARN delKinesisVideoStreamPool) puede variar para cada sumidero. -

Para transmitir solo audio individual o audio mixto, cree un objeto receptor con el

MediaStreamTypedeseado.

-

-

Tenga en cuenta lo siguiente:

-

Al invocar el CreateMediaStreamPipelineLa API con

KinesisVideoStreamPoolcomoSinkType,SinkARNdebe pertenecer a la región del plano de control en la queCreateMediaStreamPipelinese está invocando.Por ejemplo, si crea una canalización de transmisión multimedia en

us-east-1, debe usar unaKinesisVideoStreamPoolenus-east-1. -

ReservedStreamCapacitydebe ser1cuando especifique elMixedAudioMediaStreamType, y entre1-10cuando especifique elIndividualAudioMediaStreamType.

-

-

-

El plano de datos de Media Pipeline llama a la PutMediaAPI de KVS para almacenar el audio individual en una transmisión de KVS que pertenece al grupo de KVS que especifique.

-

El plano de datos de Media Pipeline llama a la API

PutMediade KVS para almacenar el audio mezclado en una transmisión que pertenece al grupo de KVS que especifique.

nota

Tras llamar al CreateMediaStreamPipelineLos creadores pueden usar la API Media Pipeline Events o llamar a GetMediaPipelineAPI para determinar si el estado de la canalización esInProgress.

Una vez alcanzado el estado InProgress de la canalización, el contenido multimedia (cualquier combinación de IndividualAudio y MixedAudio) se transmite a KVS.

Para el tipo de IndividualAudio transmisión, existe un mapeo 1:1 entre el asistente IDs y la transmisión KVS asignada desde la. KinesisVideoStreamPool El mapeo se aplica durante toda la canalización de medios.

Para saber qué transmisión de KVS se asigna a un identificador de asistente o para qué se asigna MixedAudio, utilice una de las siguientes técnicas:

-

Utilice las notificaciones de Event Bridge. Cada notificación proporciona información como el asistente IDs y el ARN de KVS que transmite el audio del asistente. Cuando se inicia una sesión de transmisión

IndividualAudiooMixedAudio, enviamos un evento dechime:MediaPipelineKinesisVideoStreamStart. Las sesiones de transmisión finalizan cuando un asistente abandona la llamada (paraIndividualAudio) o cuando finaliza la reunión. -

Utilice los metadatos persistentes que Kinesis Video Streams envía con cada fragmento. Los metadatos contienen información similar a la que envía Event Bridge. Los creadores deben analizar todas las transmisiones del

KinesisVideoStreamPoolespecificando el nombre del grupo como prefijo en el ListStreamsLa API de Kinesis Video Streams utiliza esta solución.

La finalización de la canalización de Media Stream se produce cuando se elimina la reunión o DeleteMediaPipelineLa API se invoca para esa canalización de transmisión multimedia. También se envía una notificación de Event Bridge para indicar la finalización de la canalización de contenido multimedia.