Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

Ejemplo de flujo de trabajo de análisis de tonos de voz para Amazon Chime SDK

importante

El análisis del tono de voz implica hacer predicciones sobre el sentimiento del hablante en función de la información lingüística y tonal. No debe utilizar el análisis de opiniones de ninguna manera que esté prohibida por la ley, ni siquiera en relación con la toma de decisiones sobre una persona que puedan tener repercusiones legales o similares significativas en esa persona (por ejemplo, en relación con el empleo, la vivienda, la solvencia crediticia o las ofertas financieras, etc.).

El análisis del tono de voz analiza las voces de las personas que participan en una llamada y predice sus sentimientos, ya sea positive, negative o neutral.

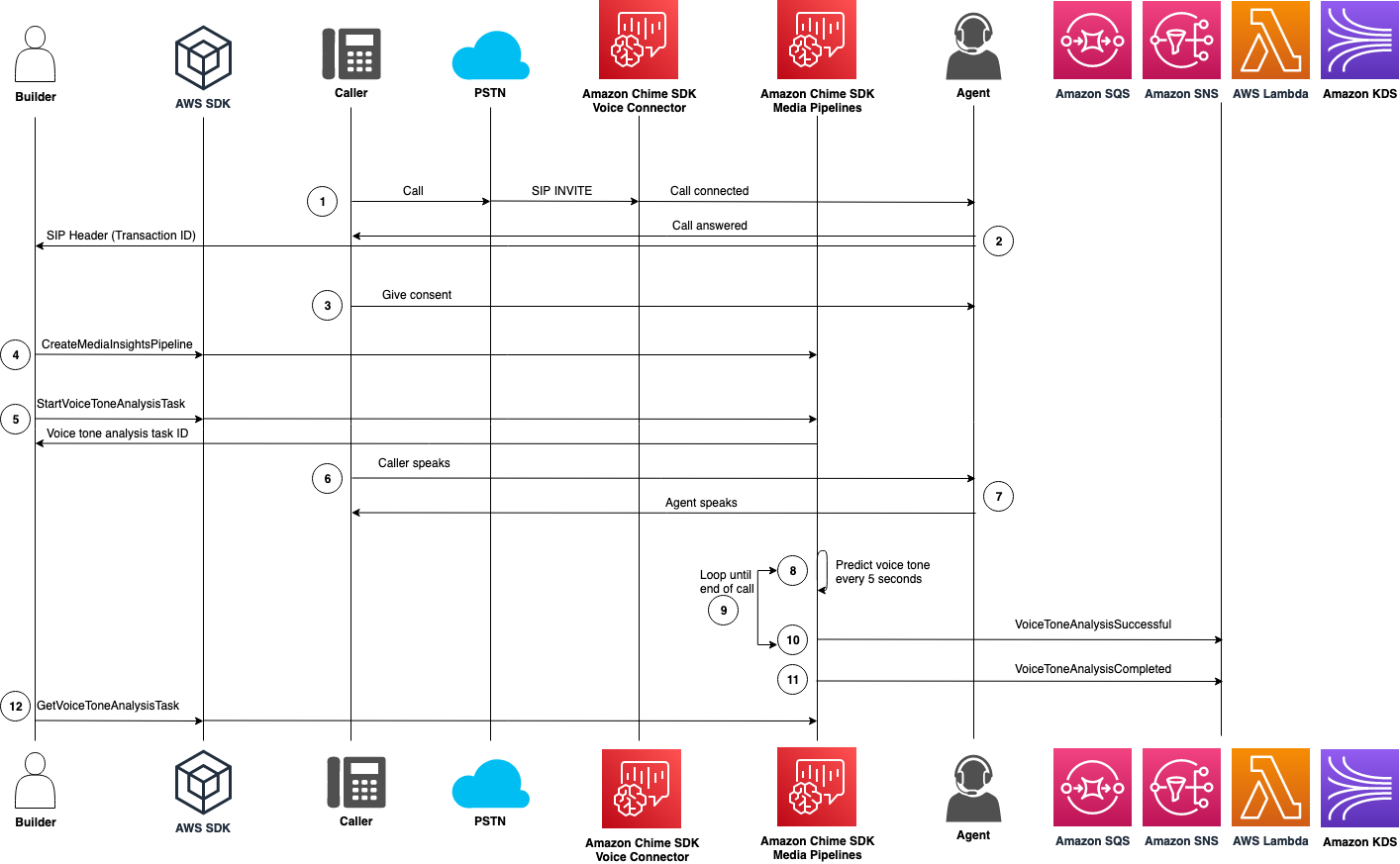

En el siguiente diagrama se muestra un ejemplo de flujo de trabajo para un análisis de tonos de voz. Los elementos numerados que aparecen debajo de la imagen describen cada paso del proceso

nota

En el diagrama se supone que ya ha configurado un conector de voz de Amazon Chime SDK con una configuración de análisis de llamadas que tiene un VoiceAnalyticsProcessor. Para obtener más información, consulte Grabar llamadas de Voice Connector.

En el diagrama:

-

Una persona llama con un número de teléfono asignado a un conector de voz de Amazon Chime SDK. O bien, un agente usa un número de Voice Connector para realizar una llamada saliente.

-

El servicio Voice Connector crea un identificador de transacción y lo asocia a la llamada.

-

Su aplicación (por ejemplo, un sistema de respuesta de voz interactiva) o su agente notifican a la persona que llama sobre la grabación de llamadas y el uso de incrustaciones de voz para el análisis de la voz y solicita su consentimiento para participar.

-

Suponiendo que su aplicación esté suscrita a EventBridge los eventos, la aplicación llamará al CreateMediaInsightsPipelineAPI con la configuración de canalización de Media Insights y Kinesis Video Stream ARNs para la llamada de Voice Connector.

Para obtener más información sobre su uso EventBridge, consulte. Descripción de los flujos de trabajo de las analíticas basadas en el machine learning para el Amazon Chime SDK

-

Una vez que la persona que llama dé su consentimiento, su solicitud o agente pueden llamar al StartSpeakerSearchTaskUtilice la API a través del SDK de voz si tiene un conector de voz y un identificador de transacción. O bien, si tienes un identificador de canalización de Media Insights en lugar de un identificador de transacción, llamas al StartSpeakerSearchTaskAPI en el SDK de Media Pipelines.

Una vez que la persona que llama dé su consentimiento, su aplicación o agente llamará a la API

StartSpeakerSearchTask. Debe pasar el ID del conector de voz, el ID de transacción y el ID de dominio del perfil de voz a la API. Se devuelve un identificador de tarea de búsqueda de hablantes para identificar la tarea asincrónica. -

El usuario habla durante toda la llamada.

-

El agente habla durante toda la llamada.

-

Cada 5 segundos, Media Insights Pipeline utiliza un modelo de machine learning para analizar los últimos 30 segundos del discurso y predecir el tono de la persona que llama durante ese intervalo y para toda la llamada desde el momento en que se llamó a

StartVoiceToneAnalysisTaskpor primera vez. -

El canal de información multimedia envía una notificación con esa información a los destinatarios de notificaciones configurados. Puede identificar la notificación en función del ARN de la transmisión y del ID del canal. Para obtener más información, consulte Descripción de las notificaciones de Amazon Chime SDK más adelante en esta sección.

-

Repita los pasos 9 y 10 hasta que finalice la llamada.

-

Al final de la llamada, Media Insights Pipeline envía una última notificación con la predicción del tono promedio actual para los últimos 30 segundos, además del tono promedio de toda la llamada.

-

Su aplicación llama al GetVoiceToneAnalysisTaskUtilice la API necesaria para obtener el estado más reciente de la tarea de análisis del tono de voz.

nota

La API

GetVoiceToneAnalysisTaskno transmite los datos de tono.

nota

la ,GetVoiceToneAnalysisTaskLa API no devuelve los datos del tono de voz.