Le traduzioni sono generate tramite traduzione automatica. In caso di conflitto tra il contenuto di una traduzione e la versione originale in Inglese, quest'ultima prevarrà.

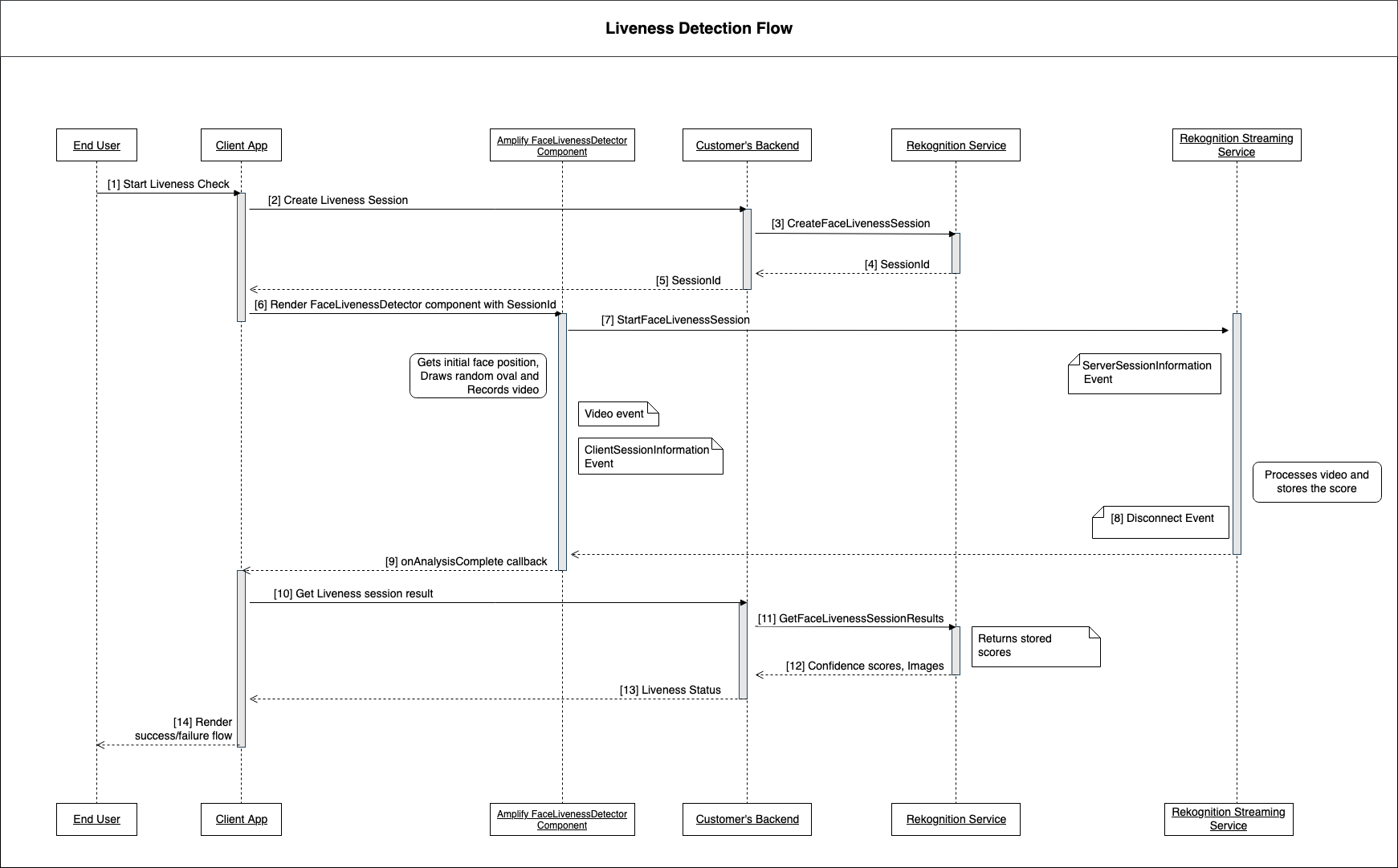

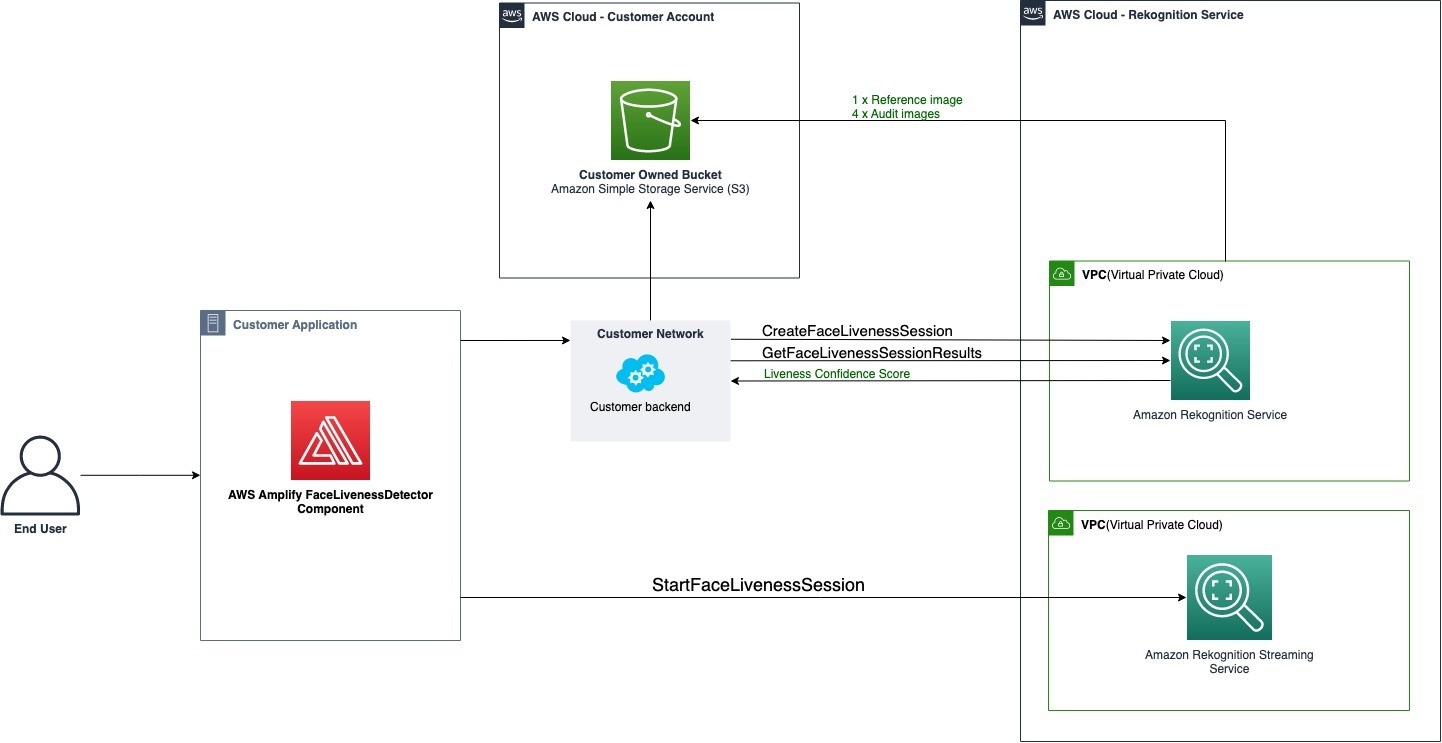

Architettura e diagrammi di sequenza

I seguenti diagrammi descrivono in dettaglio il funzionamento di Amazon Rekognition Face Liveness per quanto riguarda l'architettura e la sequenza di operazioni della funzionalità:

Il processo di verifica di Face Liveness prevede diversi passaggi, come indicato di seguito:

-

L'utente avvia un controllo di riconoscimento facciale nell'app client.

L'app client chiama il backend del cliente, che a sua volta chiama il servizio Amazon Rekognition. Il servizio crea una sessione Face Liveness e ne restituisce una unica. SessionId Nota: dopo l'invio, una SessionId lettera scade dopo 3 minuti, quindi rimane solo una finestra di 3 minuti per completare i passaggi da 3 a 7 di seguito. È necessario utilizzare un nuovo SessionID per ogni controllo di Face Liveness. Se un determinato SessionID viene utilizzato per i successivi controlli Face Liveness, i controlli avranno esito negativo. Inoltre, un SessionId scade 3 minuti dopo l'invio, rendendo non disponibili tutti i dati Liveness associati alla sessione (ad esempio, SessionID, immagine di riferimento, immagini di controllo, ecc.).

-

L'app client esegue il rendering del componente FaceLivenessDetector Amplify utilizzando i callback ottenuti e appropriati SessionId .

-

Il FaceLivenessDetector componente stabilisce una connessione al servizio di streaming Amazon Rekognition, visualizza un ovale sullo schermo dell'utente e visualizza una sequenza di luci colorate. FaceLivenessDetector registra e trasmette video in tempo reale al servizio di streaming Amazon Rekognition.

-

Il servizio di streaming Amazon Rekognition elabora il video in tempo reale, archivia i risultati e DisconnectEvent restituisce un messaggio FaceLivenessDetector al componente quando lo streaming è completo.

-

Il FaceLivenessDetector componente richiama il

onAnalysisCompletecallback per segnalare all'app client che lo streaming è completo e che i punteggi sono pronti per il recupero. -

L'app client chiama il backend del cliente per ottenere un flag booleano che indica se l'utente era attivo o meno. Il backend del cliente invia la richiesta al servizio Amazon Rekognition per ottenere il punteggio di fiducia, i riferimenti e le immagini di controllo. Il backend del cliente utilizza questi attributi per determinare se l'utente è attivo e restituisce una risposta appropriata all'app client.

-

Infine, l'app client trasmette la risposta al FaceLivenessDetector componente, che esegue il rendering appropriato del success/failure messaggio per completare il flusso.