Le traduzioni sono generate tramite traduzione automatica. In caso di conflitto tra il contenuto di una traduzione e la versione originale in Inglese, quest'ultima prevarrà.

Moderazione dei contenuti

Puoi usare Amazon Rekognition per rilevare contenuti inappropriati, indesiderati o offensivi. Puoi utilizzare la APIs moderazione di Rekognition nei social media, nei media radiotelevisivi, nella pubblicità e nell'e-commerce per creare un'esperienza utente più sicura, fornire garanzie di sicurezza del marchio agli inserzionisti e rispettare le normative locali e globali.

Oggi, molte aziende si affidano esclusivamente a moderatori umani per esaminare i contenuti di terze parti o generati dagli utenti, mentre altre reagiscono semplicemente ai reclami degli utenti rimuovendo immagini, annunci o video offensivi o inappropriati. Tuttavia, i moderatori umani da soli non sono in grado di soddisfare queste esigenze con una qualità o una velocità sufficienti, il che comporta un'esperienza utente scadente, costi elevati per raggiungere la scalabilità o persino una perdita di reputazione del marchio. Utilizzando Rekognition per la moderazione di immagini e video, i moderatori umani possono esaminare un set di contenuti molto più piccolo, in genere dall'1 al 5% del volume totale, già contrassegnato dal machine learning. Ciò consente loro di concentrarsi su attività più importanti e di ottenere comunque una copertura di moderazione completa a una frazione dei costi esistenti. Per configurare forza lavoro umana ed eseguire attività di revisione umana, puoi utilizzare IA aumentata Amazon, che è già integrato con Rekognition.

Puoi migliorare la precisione del modello di deep learning di moderazione con la funzionalità di moderazione personalizzata. Con la moderazione personalizzata, puoi addestrare un adattatore di moderazione personalizzato caricando le tue immagini e annotandole. L'adattatore qualificato può quindi essere fornito all'DetectModerationLabelsoperazione per migliorarne le prestazioni sulle immagini. Per ulteriori informazioni, consulta Migliorare la precisione con la moderazione personalizzata.

Etichette supportate dalle operazioni di moderazione dei contenuti di Rekognition

Argomenti

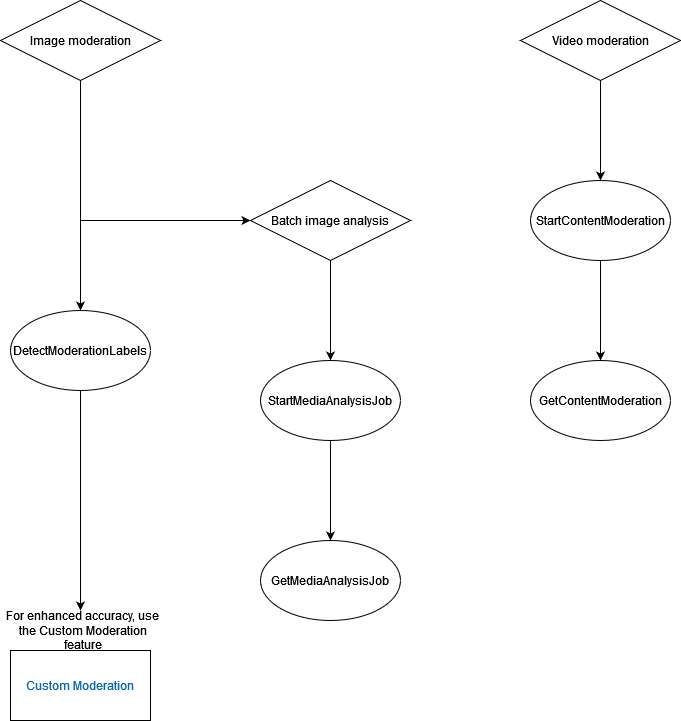

Il diagramma seguente mostra l'ordine delle operazioni di chiamata, a seconda degli obiettivi prefissati per l'utilizzo dei componenti immagine o video di Content Moderation: