As traduções são geradas por tradução automática. Em caso de conflito entre o conteúdo da tradução e da versão original em inglês, a versão em inglês prevalecerá.

Como funcionam as bases de conhecimento do Amazon Bedrock

As bases de conhecimento Amazon Bedrock ajudam você a aproveitar as vantagens da Retrieval Augmented Generation (RAG), uma técnica popular que envolve extrair informações de um armazenamento de dados para aumentar as respostas geradas pelos Large Language Models (). LLMs Quando você configura uma base de conhecimento com sua fonte de dados, seu aplicativo pode consultar a base de conhecimento para retornar informações para responder à consulta com cotações diretas das fontes ou com respostas naturais geradas a partir dos resultados da consulta.

Com o Amazon Bedrock Knowledge Bases, você pode criar aplicativos que são enriquecidos pelo contexto recebido da consulta de uma base de conhecimento. Ele permite um tempo de lançamento mais rápido no mercado ao se abstrair do trabalho pesado dos pipelines de construção e fornecer a você uma solução out-of-the-box RAG para reduzir o tempo de construção de seu aplicativo. Adicionar uma base de conhecimento também aumenta a relação custo-benefício, eliminando a necessidade de treinar continuamente o modelo para poder aproveitar os dados privados.

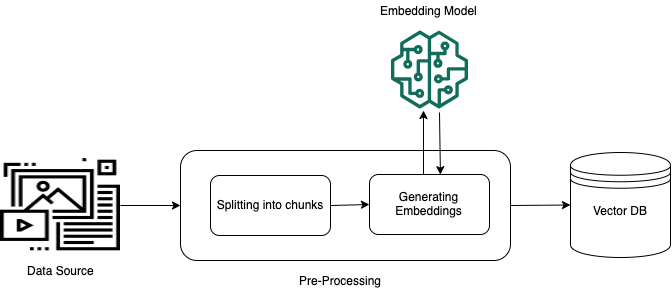

Os diagramas a seguir ilustram esquematicamente como a RAG é realizada. A base de conhecimento simplifica a configuração e a implementação da RAG, automatizando várias etapas desse processo.

Pré-processamento de dados não estruturados

Para permitir a recuperação efetiva de dados privados não estruturados (dados que não existem em um armazenamento de dados estruturado), uma prática comum é converter os dados em texto e dividi-los em partes gerenciáveis. As partes ou fragmentos são convertidos em incorporações e gravados em um índice de vetores, mantendo uma correção com o documento original. Essas incorporações são usadas para determinar a semelhança semântica entre as consultas e o texto das fontes de dados. A imagem a seguir ilustra o pré-processamento de dados para o banco de dados de vetores.

As incorporações vetoriais são uma série de números que representam cada parte do texto. Um modelo converte cada fragmento de texto em uma série de números, conhecidos como vetores, para que os textos possam ser comparados matematicamente. Esses vetores podem ser números de ponto flutuante (float32) ou números binários. A maioria dos modelos de incorporação suportados pelo Amazon Bedrock usa vetores de ponto flutuante por padrão. No entanto, alguns modelos oferecem suporte a vetores binários. Se você escolher um modelo de incorporação binária, também deverá escolher um modelo e um repositório vetorial que ofereça suporte a vetores binários.

Os vetores binários, que usam apenas 1 bit por dimensão, não são tão caros no armazenamento quanto os vetores de ponto flutuante (float32), que usam 32 bits por dimensão. No entanto, os vetores binários não são tão precisos quanto os vetores de ponto flutuante em sua representação do texto.

O exemplo a seguir mostra um trecho de texto em três representações:

| Representação | Valor |

|---|---|

| Texto | “O Amazon Bedrock usa modelos básicos de alto desempenho das principais empresas de IA e da Amazon.” |

| Vetor de ponto flutuante | [0.041..., 0.056..., -0.018..., -0.012..., -0.020...,

...] |

| Vetor binário | [1,1,0,0,0, ...] |

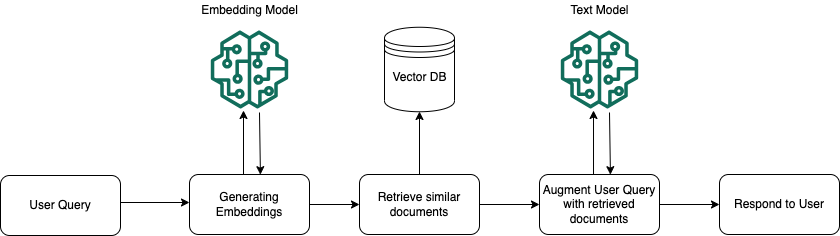

Execução do Runtime

Em tempo de execução, um modelo de incorporação é usado para converter a consulta do usuário em um vetor. O índice de vetores é consultado para encontrar partes que sejam semanticamente semelhantes à consulta do usuário, comparando os vetores do documento com o vetor de consulta do usuário. Na etapa final, o prompt do usuário é aumentado com o contexto adicional dos fragmentos que são recuperados do índice de vetores. O prompt e o contexto adicional são enviados ao modelo para gerar uma resposta para o usuário. A imagem a seguir ilustra como a RAG opera em tempo de execução para aumentar as respostas às consultas dos usuários.

Para saber mais sobre como transformar seus dados em uma base de conhecimento, como consultar sua base de conhecimento depois de configurá-la e personalizações que você pode aplicar à fonte de dados durante a ingestão, consulte os tópicos a seguir: