Terjemahan disediakan oleh mesin penerjemah. Jika konten terjemahan yang diberikan bertentangan dengan versi bahasa Inggris aslinya, utamakan versi bahasa Inggris.

Ekspor konfigurasi untuk tujuan AWS Cloud yang didukung

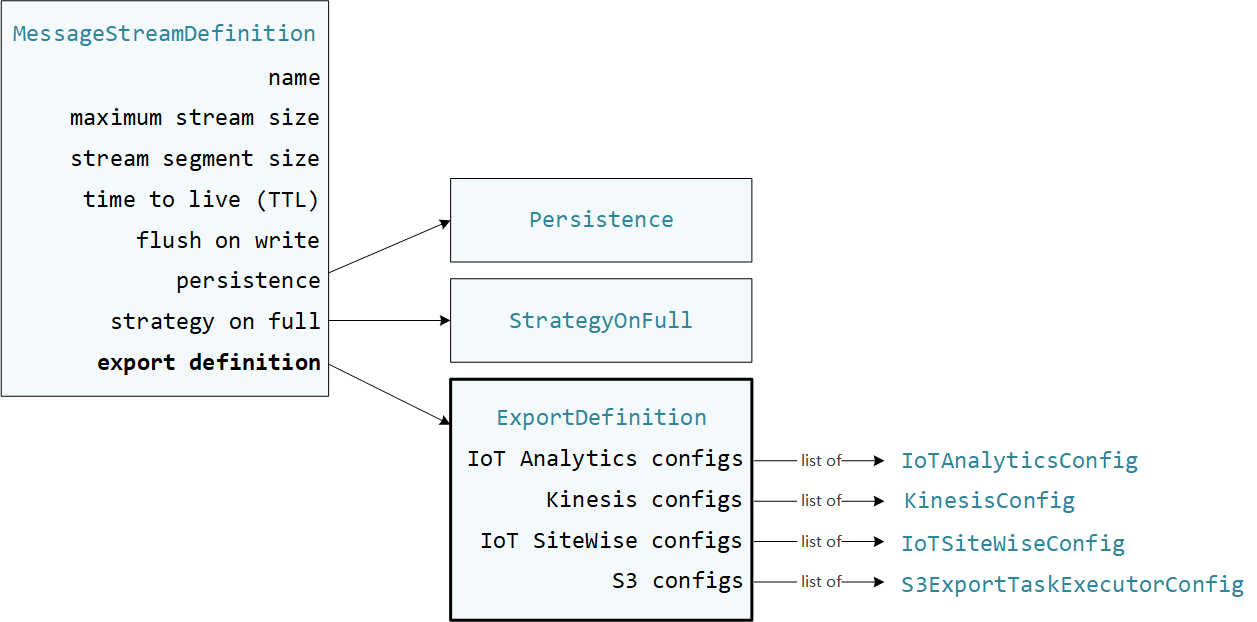

Komponen Greengrass yang ditentukan pengguna menggunakan StreamManagerClient di SDK Stream Manager untuk berinteraksi dengan stream manager. Ketika komponen membuat aliran atau memperbarui aliran, melewati objek MessageStreamDefinition yang mewakili properti aliran, termasuk definisi ekspor. Objek ExportDefinition berisi konfigurasi ekspor yang ditentukan untuk aliran tersebut. Stream manager menggunakan konfigurasi ekspor ini untuk menentukan di mana dan bagaimana untuk mengekspor aliran tersebut.

Anda dapat menentukan konfigurasi ekspor nol atau lebih pada suatu aliran, termasuk beberapa konfigurasi ekspor untuk satu jenis tujuan. Misalnya, Anda dapat mengekspor aliran ke dua saluran AWS IoT Analytics dan satu Kinesis data stream.

Untuk upaya ekspor yang gagal, manajer aliran terus mencoba mengekspor data ke AWS Cloud interval hingga lima menit. Jumlah upaya coba lagi tidak memiliki batas maksimum.

catatan

StreamManagerClient juga menyediakan target tujuan yang dapat Anda gunakan untuk mengekspor aliran ke server HTTP. Target ini ditujukan untuk tujuan pengujian saja. Target ini tidak stabil atau didukung untuk digunakan di lingkungan produksi.

AWS Cloud Tujuan yang didukung

Anda bertanggung jawab untuk memelihara AWS Cloud sumber daya ini.

AWS IoT Analytics saluran

Manajer aliran mendukung ekspor otomatis ke AWS IoT Analytics. AWS IoT Analytics memungkinkan Anda melakukan analisis lanjutan pada data Anda untuk membantu membuat keputusan bisnis dan meningkatkan model pembelajaran mesin. Untuk informasi lebih lanjut, lihat Apa itu AWS IoT Analytics? dalam AWS IoT Analytics User Guide.

Dalam SDK Stream Manager, komponen Greengrass Anda menggunakan IoTAnalyticsConfig untuk menentukan konfigurasi ekspor untuk jenis tujuan ini. Untuk informasi lebih lanjut, lihat referensi SDK untuk bahasa target Anda:

-

Io TAnalytics Config

di Java SDK

Persyaratan

Tujuan ekspor ini memiliki persyaratan sebagai berikut:

-

Saluran target AWS IoT Analytics harus sama Akun AWS dan Wilayah AWS sebagai perangkat inti Greengrass.

-

Otorisasi perangkat inti untuk berinteraksi dengan AWS layanan harus memungkinkan izin

iotanalytics:BatchPutMessageuntuk menargetkan saluran. Misalnya:Anda dapat memberikan akses terperinci atau bersyarat ke sumber daya, misalnya dengan menggunakan skema penamaan wildcard

*. Untuk informasi lebih lanjut, lihat Menambahkan dan menghapus kebijakan IAM dalam Panduan Pengguna IAM.

Mengekspor ke AWS IoT Analytics

Untuk membuat aliran yang diekspor AWS IoT Analytics, komponen Greengrass Anda membuat aliran dengan definisi ekspor yang menyertakan satu atau beberapa objek. IoTAnalyticsConfig Objek ini menentukan pengaturan ekspor, seperti target saluran, ukuran batch, interval batch, dan prioritas.

Ketika komponen Greengrass Anda menerima data dari perangkat, komponen itu menambahkan pesan yang berisi gumpalan data ke aliran target.

Kemudian, stream manager mengekspor data berdasarkan pengaturan batch dan prioritas yang ditentukan dalam konfigurasi ekspor aliran.

Amazon Kinesis data streams

Stream manager mendukung ekspor otomatis ke Amazon Kinesis Data Streams. Kinesis Data Streams biasanya digunakan untuk mengumpulkan data volume tinggi dan memuatnya ke dalam gudang data atau cluster. MapReduce Untuk informasi selengkapnya, lihat Apa yang dimaksud dengan Amazon Kinesis Data Streams? dalam Panduan Developer Amazon Kinesis.

Dalam SDK Stream Manager, komponen Greengrass Anda menggunakan KinesisConfig untuk menentukan konfigurasi ekspor untuk jenis tujuan ini. Untuk informasi lebih lanjut, lihat referensi SDK untuk bahasa target Anda:

-

KinesisConfig

di Python SDK -

KinesisConfig

di Java SDK -

KinesisConfig

di Node.js SDK

Persyaratan

Tujuan ekspor ini memiliki persyaratan sebagai berikut:

-

Aliran target di Kinesis Data Streams harus sama Akun AWS dan Wilayah AWS sebagai perangkat inti Greengrass.

-

(Disarankan) Stream manager v2.2.1 meningkatkan kinerja mengekspor stream ke tujuan Kinesis Data Streams. Untuk menggunakan peningkatan dalam versi terbaru ini, tingkatkan komponen pengelola aliran Anda ke v2.2.1 dan gunakan kinesis:ListShards kebijakan dalam peran pertukaran token Greengrass.

-

Otorisasi perangkat inti untuk berinteraksi dengan AWS layanan harus memungkinkan izin

kinesis:PutRecordsuntuk menargetkan aliran data. Misalnya:Anda dapat memberikan akses terperinci atau bersyarat ke sumber daya, misalnya dengan menggunakan skema penamaan wildcard

*. Untuk informasi lebih lanjut, lihat Menambahkan dan menghapus kebijakan IAM dalam Panduan Pengguna IAM.

Mengekspor ke Kinesis Data Streams

Untuk membuat pengaliran yang diekspor ke Kinesis Data Streams, komponen Greengrass Anda membuat pengaliran dengan definisi ekspor yang mencakup satu atau lebih objek KinesisConfig. Objek ini menentukan pengaturan ekspor, seperti target aliran data, ukuran batch, interval batch, dan prioritas.

Ketika komponen Greengrass Anda menerima data dari perangkat, komponen itu menambahkan pesan yang berisi gumpalan data ke aliran target. Kemudian, stream manager mengekspor data berdasarkan pengaturan batch dan prioritas yang ditentukan dalam konfigurasi ekspor aliran.

Stream manager menghasilkan UUID acak yang unik sebagai kunci partisi untuk setiap rekaman yang diunggah ke Amazon Kinesis.

AWS IoT SiteWise properti aset

Manajer aliran mendukung ekspor otomatis ke AWS IoT SiteWise. AWS IoT SiteWise memungkinkan Anda mengumpulkan, mengatur, dan menganalisis data dari peralatan industri dalam skala besar. Untuk informasi lebih lanjut, lihat Apa itu AWS IoT SiteWise? dalam AWS IoT SiteWise User Guide.

Dalam SDK Stream Manager, komponen Greengrass Anda menggunakan IoTSiteWiseConfig untuk menentukan konfigurasi ekspor untuk jenis tujuan ini. Untuk informasi lebih lanjut, lihat referensi SDK untuk bahasa target Anda:

-

Io TSite WiseConfig

dalam SDK Python -

Io TSite WiseConfig

di Java SDK -

Io TSite WiseConfig

di Node.js SDK

catatan

AWS juga menyediakan AWS IoT SiteWise komponen, yang menawarkan solusi pra-bangun yang dapat Anda gunakan untuk mengalirkan data dari sumber OPC-UA. Untuk informasi selengkapnya, lihat Kolektor IoT SiteWise OPC UA.

Persyaratan

Tujuan ekspor ini memiliki persyaratan sebagai berikut:

-

Properti aset target AWS IoT SiteWise harus sama Akun AWS dan Wilayah AWS sebagai perangkat inti Greengrass.

catatan

Untuk daftar Wilayah AWS s yang AWS IoT SiteWise mendukung, lihat AWS IoT SiteWise titik akhir dan kuota di Referensi AWS Umum.

-

Otorisasi perangkat inti untuk berinteraksi dengan AWS layanan harus memungkinkan izin

iotsitewise:BatchPutAssetPropertyValueuntuk menargetkan properti aset. Kebijakan berikut menggunakan kunci kondisiiotsitewise:assetHierarchyPathuntuk memberikan akses ke aset akar target dan anak-anaknya. Anda dapat menghapusConditiondari kebijakan untuk mengizinkan akses ke semua AWS IoT SiteWise aset Anda atau menentukan ARNs aset individu.Anda dapat memberikan akses terperinci atau bersyarat ke sumber daya, misalnya dengan menggunakan skema penamaan wildcard

*. Untuk informasi lebih lanjut, lihat Menambahkan dan menghapus kebijakan IAM dalam Panduan Pengguna IAM.Untuk informasi keamanan penting, lihat BatchPutAssetPropertyValue otorisasi di Panduan AWS IoT SiteWise Pengguna.

Mengekspor ke AWS IoT SiteWise

Untuk membuat aliran yang diekspor AWS IoT SiteWise, komponen Greengrass Anda membuat aliran dengan definisi ekspor yang menyertakan satu atau beberapa objek. IoTSiteWiseConfig Objek ini menentukan pengaturan ekspor, seperti ukuran batch, interval batch, dan prioritas.

Ketika komponen Greengrass Anda menerima data properti aset dari perangkat, komponen itu menambahkan pesan yang berisi data ke aliran target. Pesan merupakan objek PutAssetPropertyValueEntry berseri JSON yang berisi nilai properti untuk satu atau lebih properti aset. Untuk informasi selengkapnya, lihat: Tambahkan pesan untuk tujuan ekspor AWS IoT SiteWise

.

catatan

Saat Anda mengirim data ke AWS IoT SiteWise, data Anda harus memenuhi persyaratan BatchPutAssetPropertyValue tindakan. Untuk informasi selengkapnya, lihat BatchPutAssetPropertyValue di dalam Referensi API AWS IoT SiteWise .

Kemudian, stream manager mengekspor data berdasarkan pengaturan batch dan prioritas yang ditentukan dalam konfigurasi ekspor aliran.

Anda dapat menyesuaikan pengaturan stream manager dan logika komponen Greengrass untuk merancang strategi ekspor Anda. Misalnya:

-

Untuk ekspor yang mendekati real time, atur ukuran batch dan pengaturan interval yang rendah dan tambahkan data ke aliran saat diterima.

-

Untuk mengoptimalkan batching, mengurangi batasan bandwidth, atau meminimalkan biaya, komponen Greengrass Anda dapat mengumpulkan titik data timestamp-quality-value (TQV) yang diterima untuk satu properti aset sebelum menambahkan data ke aliran. Salah satu strateginya adalah mengelompokkan entri hingga 10 kombinasi aset properti yang berbeda, atau alias properti, dalam satu pesan, dan bukan mengirim lebih dari satu entri untuk properti yang sama. Hal ini membantu manajer pengaliran untuk tetap berada dalam kuota AWS IoT SiteWise.

Objek Amazon S3

Stream manager mendukung ekspor otomatis ke Amazon S3. Sebagai contoh, Anda dapat menggunakan Amazon S3 untuk menyimpan dan mengambil sejumlah besar data. Untuk informasi selengkapnya, lihat Apa itu Amazon S3? dalam Panduan Developer Amazon Simple Storage Service.

Dalam SDK Stream Manager, komponen Greengrass Anda menggunakan S3ExportTaskExecutorConfig untuk menentukan konfigurasi ekspor untuk jenis tujuan ini. Untuk informasi lebih lanjut, lihat referensi SDK untuk bahasa target Anda:

-

S3 ExportTaskExecutorConfig

di Python SDK -

S3 ExportTaskExecutorConfig

di Java SDK -

S3 ExportTaskExecutorConfig

di Node.js SDK

Persyaratan

Tujuan ekspor ini memiliki persyaratan sebagai berikut:

-

Target ember Amazon S3 harus sama dengan perangkat inti Akun AWS Greengrass.

-

Jika fungsi Lambda yang berjalan dalam mode container Greengrass menulis file input ke direktori file input, Anda harus me-mount direktori sebagai volume dalam wadah dengan izin tulis. Ini memastikan bahwa file ditulis ke sistem file root dan terlihat oleh komponen manajer aliran, yang berjalan di luar wadah.

-

Jika komponen kontainer Docker menulis file input ke direktori file input, Anda harus me-mount direktori sebagai volume dalam wadah dengan izin tulis. Ini memastikan bahwa file ditulis ke sistem file root dan terlihat oleh komponen manajer aliran, yang berjalan di luar wadah.

-

Otorisasi perangkat inti untuk berinteraksi dengan AWS layanan harus memungkinkan izin berikut untuk target bucket. Misalnya:

Anda dapat memberikan akses terperinci atau bersyarat ke sumber daya, misalnya dengan menggunakan skema penamaan wildcard

*. Untuk informasi lebih lanjut, lihat Menambahkan dan menghapus kebijakan IAM dalam Panduan Pengguna IAM.

Mengekspor ke Amazon S3

Untuk membuat aliran yang diekspor ke Amazon S3, komponen Greengrass Anda menggunakan objek S3ExportTaskExecutorConfig untuk mengonfigurasi kebijakan ekspor. Kebijakan ini menentukan pengaturan ekspor, seperti ambang batas dan prioritas unggahan multipart. Untuk ekspor Amazon S3, stream manager akan mengunggah data yang dibaca dari file lokal pada perangkat inti. Untuk memulai unggahan, komponen Greengrass Anda menambahkan tugas ekspor ke aliran target. Tugas ekspor berisi informasi tentang file input dan objek Amazon S3 target. Stream manager menjalankan tugas dalam urutan yang ditambahkan ke aliran.

catatan

Ember target harus sudah ada di Anda Akun AWS. Jika objek untuk kunci tertentu tidak ada, stream manager akan membuatnya untuk Anda.

Manajer pengaliran menggunakan properti ambang batas unggahan multipart, pengaturan ukuran bagian minimum, dan ukuran file input untuk menentukan cara mengunggah data. Ambang batas unggahan multipart harus lebih besar atau sama dengan ukuran bagian minimum. Jika Anda ingin meng-upload data secara paralel, Anda dapat membuat beberapa aliran.

Kunci yang menentukan objek Amazon S3 target Anda dapat menyertakan DateTimeFormatter string Java!{timestamp: Anda dapat menggunakan placeholder stempel waktu ini untuk membagi data di Amazon S3 berdasarkan waktu data file input tersebut diunggah. Sebagai contoh, nama kunci berikut memutuskan untuk nilai seperti value}my-key/2020/12/31/data.txt.

my-key/!{timestamp:YYYY}/!{timestamp:MM}/!{timestamp:dd}/data.txt

catatan

Jika Anda ingin memantau status ekspor untuk suatu aliran, pertama-tama buat status aliran dan kemudian konfigurasi aliran ekspor untuk menggunakannya. Untuk informasi selengkapnya, lihat Pantau tugas ekspor.

Kelola data input

Anda dapat menuliskan kode yang digunakan oleh aplikasi IoT untuk mengelola siklus hidup data input. Contoh alur kerja berikut menunjukkan bagaimana Anda mungkin menggunakan komponen Greengrass untuk mengelola data ini.

-

Proses lokal menerima data dari perangkat atau periferal, dan kemudian menuliskan data ke file dalam direktori pada perangkat inti. Ini adalah file input untuk stream manager.

-

Komponen Greengrass memindai direktori dan menambahkan tugas ekspor ke aliran target ketika file baru dibuat. Tugas tersebut adalah objek

S3ExportTaskDefinitionJSON berseri yang menentukan URL file input, bucket dan kunci Amazon S3 target, dan metadata pengguna opsional. -

Stream manager membaca file input dan mengekspor data ke Amazon S3 dalam urutan tugas yang ditambahkan. Ember target harus sudah ada di Anda Akun AWS. Jika objek untuk kunci tertentu tidak ada, stream manager akan membuatnya untuk Anda.

-

Komponen Greengrass membaca pesan dari aliran status untuk memantau status ekspor. Setelah tugas ekspor selesai, komponen Greengrass dapat menghapus file input yang sesuai. Untuk informasi selengkapnya, lihat Pantau tugas ekspor.

Pantau tugas ekspor

Anda dapat menuliskan kode yang digunakan oleh aplikasi IoT untuk memantau status ekspor Amazon S3 Anda. Komponen Greengrass Anda harus membuat status aliran dan kemudian mengonfigurasi aliran ekspor untuk menuliskan pembaruan status pada status aliran. Aliran status tunggal dapat menerima pembaruan status dari beberapa aliran yang diekspor ke Amazon S3.

Pertama-tama, buat aliran yang akan digunakan sebagai status aliran. Anda dapat mengonfigurasi kebijakan ukuran dan penyimpanan bagi aliran tersebut untuk mengontrol umur pesan status. Misalnya:

-

Tetapkan

PersistencekeMemoryjika Anda tidak ingin menyimpan pesan status. -

Tetapkan

StrategyOnFullkeOverwriteOldestDataagar pesan status baru tidak hilang.

Kemudian, buat atau perbarui aliran ekspor untuk menggunakan status aliran. Secara khusus, atur properti konfigurasi status pada konfigurasi ekspor S3ExportTaskExecutorConfig aliran. Pengaturan ini memberitahu stream manager untuk menuliskan pesan status tentang tugas ekspor ke status aliran. Di objek StatusConfig, tentukan nama status pengaliran dan tingkat verbositasnya. Nilai yang didukung berikut berkisar dari verbositas paling kecil (ERROR) hingga verbositas tertinggi (TRACE). Default-nya adalah INFO.

-

ERROR -

WARN -

INFO -

DEBUG -

TRACE

Contoh alur kerja berikut menunjukkan bagaimana komponen Greengrass mungkin menggunakan status aliran untuk memantau status ekspor.

-

Seperti yang dijelaskan dalam alur kerja sebelumnya, sebuah komponen Greengrass menambahkan tugas ekspor ke aliran yang dikonfigurasi untuk menuliskan pesan status tentang tugas ekspor ke aliran status. Operasi append mengembalikan nomor urut yang mewakili ID tugas.

-

Komponen Greengrass membaca pesan secara berurutan dari aliran status, dan kemudian menyaring pesan berdasarkan nama aliran dan ID tugas atau berdasarkan properti tugas ekspor dari konteks pesan. Sebagai contoh, komponen Greengrass dapat memfilter dengan URL file input dari tugas ekspor, yang diwakili oleh objek

S3ExportTaskDefinitiondalam konteks pesan tersebut.Kode status berikut menunjukkan bahwa tugas ekspor telah mencapai keadaan lengkap:

-

Success. Upload berhasil diselesaikan. -

Failure. Stream manager mengalami kesalahan, misalnya, bucket yang ditentukan tidak ada. Setelah menyelesaikan masalah, Anda dapat menambahkan tugas ekspor ke aliran lagi. -

Canceled. Tugas dihentikan karena definisi aliran atau ekspor dihapus, atau periode time-to-live (TTL) tugas berakhir.

catatan

Tugas mungkin juga memiliki status

InProgressatauWarning. Stream manager mengeluarkan peringatan ketika peristiwa mengembalikan kesalahan yang tidak mempengaruhi pelaksanaan tugas. Sebagai contoh, kegagalan untuk membersihkan sebagian unggahan akan mengembalikan peringatan. -

-

Setelah tugas ekspor selesai, komponen Greengrass dapat menghapus file input yang sesuai.

Contoh berikut menunjukkan bagaimana komponen Greengrass mungkin membaca dan memproses pesan status.