翻訳は機械翻訳により提供されています。提供された翻訳内容と英語版の間で齟齬、不一致または矛盾がある場合、英語版が優先します。

コンテンツのモデレーション

Amazon Rekognition を使用して、不適切、望ましくない、または不快なコンテンツを検出できます。ソーシャルメディア、放送メディア、広告、電子商取引の状況で Rekognition モデレーション API を使用して、より安全なユーザーエクスペリエンスを作成し、広告主にブランド安全を保証し、ローカルおよびグローバル規制に準拠できます。

今日、多くの企業は、第三者またはユーザーが生成したコンテンツをレビューするために人間のモデレーターに完全に依存しており、他の企業はユーザーの苦情に単に反応して、攻撃的または不適切な画像、広告、動画を削除しています。しかし、人間のモデレーターだけでは十分な品質やスピードでこれらのニーズを満たすようにスケールすることはできず、ユーザーエクスペリエンスの低下、スケール達成のための高コスト、ブランドの評判の喪失につながります。Rekognition をイメージおよびビデオのモデレーションに使用することで、人間のモデレーターは、機械学習によってすでにフラグが付けられている総ボリュームの 1 - 5% のかなり小さいコンテンツセットを確認することができます。これにより、より価値ある活動に集中し、既存のコストの一部で包括的なモデレーションカバレッジを実現できます。人間の労働力をセットアップし、ヒューマンレビュータスクを実行するには、すでに Rekognition と統合されている Amazon Augmented AI を使用できます。

カスタムモデレーション機能を使用すると、モデレーション深層学習モデルの精度を高めることができます。カスタムモデレーションでは、イメージをアップロードして注釈を付けることにより、カスタムモデレーションアダプターをトレーニングします。このトレーニング済みのアダプターを DetectModerationLabels オペレーションに提供すると、イメージに関するパフォーマンスを高めることができます。詳細については「カスタムモデレーションによる精度の向上」を参照してください。

Rekognition のコンテンツのモデレーションオペレーションでサポートされているラベル

-

モデレーションラベルのリストをダウンロードするには、ここをクリックします。

トピック

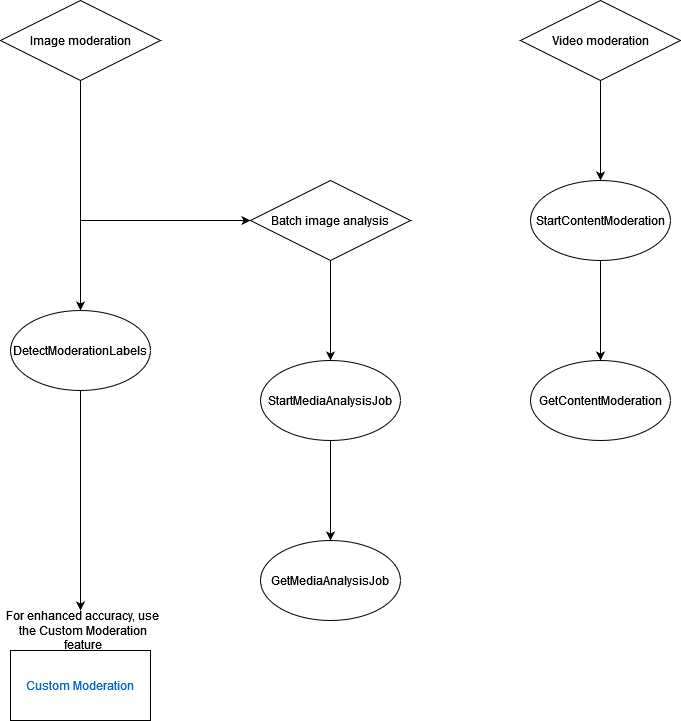

以下の図は、コンテンツモデレーションの画像またはビデオコンポーネントの使用目的に応じて、必要なオペレーションを呼び出す順序を示しています。