Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

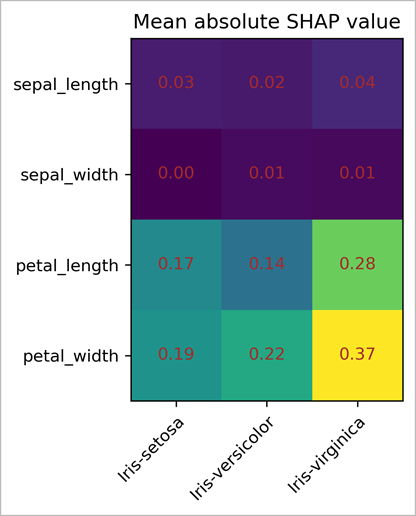

Comprender cómo las características contribuyen al resultado general de un modelo proporciona una visión general que es útil para la selección de características y el desarrollo del modelo. Para medir el efecto de añadir una nueva característica, normalmente se ejecuta una validación cruzada con y sin la característica. Sin embargo, realizar una validación cruzada para todas las combinaciones de características y todos los tipos de modelos considerados suele ser inviable debido al costo computacional. Por lo tanto, otros métodos para determinar la importancia de las características son útiles para tomar decisiones rápidas. Nuestra recomendación para determinar las atribuciones de características globales es agregar las puntuaciones de atribución de características locales recomendadas en la sección anterior en todos los datos. También recomendamos calcular el cambio en la puntuación de validación cruzada cuando se elimina una característica, si las restricciones de tiempo y de cálculo lo permiten. El siguiente ejemplo ilustra la agregación de puntuaciones de atribución locales. Promedia las magnitudes de los valores de SHAP para el modelo de clasificación del iris (extraídos de la descripción general) y los traza como un mapa térmico. Se puede observar que las medidas del sépalo no juegan un papel importante en el modelo para determinar la clase del iris.

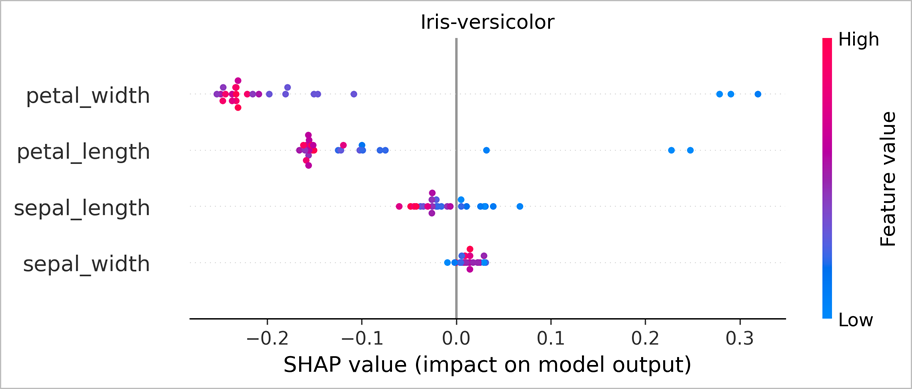

Para obtener un resultado de modelo específico, la recopilación de valores de SHAP en las instancias de evaluación se puede visualizar en un gráfico de enjambre de abejas, como se ilustra en el siguiente diagrama (para un subconjunto de datos del conjunto de datos del iris [4]). Aquí puede ver que el atributo petal_width tiene el mayor efecto en la salida del modelo de la clase Iris-versicolor y que un valor petal_width alto contribuye negativamente a la predicción de la clase. Cuando más de un punto de datos tiene el mismo valor de atribución de características o muy similar, los puntos se apilan para indicar la mayor prevalencia en esa ubicación.