Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

Recherche de visages dans une collection

Amazon Rekognition vous permet d’utiliser un visage en entrée pour rechercher des correspondances dans une collection de visages enregistrés. Vous commencez par stocker des informations sur les visages détectés dans des conteneurs côté serveur appelés « collections ». Les collections stockent à la fois les visages individuels et les utilisateurs (plusieurs visages d'une même personne). Les visages individuels sont stockés sous forme de vecteurs de visage, une représentation mathématique du visage (et non une image réelle du visage). Différentes images d'une même personne peuvent être utilisées pour créer et stocker plusieurs vecteurs de visage dans la même collection. Vous pouvez ensuite agréger plusieurs vecteurs de visage de la même personne pour créer un vecteur utilisateur. Les vecteurs utilisateur peuvent offrir une plus grande précision de recherche faciale grâce à des représentations plus robustes, contenant différents degrés d’éclairage, de netteté, de pose, d’apparence, etc.

Une fois que vous avez créé une collection, vous pouvez utiliser un visage en entrée pour rechercher des vecteurs utilisateur ou des vecteurs de visage correspondants dans une collection. La recherche par rapport aux vecteurs utilisateur peut améliorer considérablement la précision comparée à la recherche par rapport à des vecteurs faciaux individuels. Vous pouvez utiliser des visages détectés dans des images, des vidéos stockées et des vidéos en streaming pour rechercher des vecteurs de visage stockés. Vous pouvez utiliser les visages détectés dans les images pour effectuer une recherche par rapport aux vecteurs utilisateur enregistrés.

Pour stocker les informations faciales, vous devez procéder comme suit :

-

Créer une collection - Pour stocker des informations faciales, vous devez d'abord créer (CreateCollection) une collection faciale dans l'une des AWS régions de votre compte. Vous spécifiez cette collection de visages lorsque vous appelez l’opération

IndexFaces. -

Index des visages : l'IndexFacesopération détecte le ou les visages dans une image, extrait et stocke le ou les vecteurs de visage dans la collection. Cette opération vous permet de détecter les visages dans une image et de conserver les informations sur les caractéristiques faciales détectées dans une collection. Voici un exemple d’opération d’API basée sur le stockage, car le service conserve sur le serveur les informations relatives au vecteur de visage.

Pour créer un utilisateur et associer plusieurs vecteurs de visage à un utilisateur, vous devez effectuer les opérations suivantes :

-

Créer un utilisateur - Vous devez d'abord créer un utilisateur avec CreateUser. Vous pouvez améliorer la précision de la correspondance faciale en agrégeant plusieurs vecteurs de visage d’une même personne dans un vecteur utilisateur. Vous pouvez associer jusqu’à 100 vecteurs de visage à un vecteur utilisateur.

-

Associer des visages : après avoir créé l'utilisateur, vous pouvez ajouter des vecteurs de visage existants à cet utilisateur par le biais de l'AssociateFacesopération. Les vecteurs de visage doivent résider dans la même collection qu’un vecteur utilisateur pour être associés à ce vecteur utilisateur.

Après avoir créé une collection et enregistré les vecteurs de visages et d’utilisateurs, vous pouvez utiliser les opérations suivantes pour rechercher des correspondances de visages :

-

SearchFacesByImage- Pour effectuer une recherche dans des visages individuels enregistrés à l'aide d'un visage issu d'une image.

-

SearchFaces- Pour effectuer une recherche parmi des visages individuels enregistrés à l'aide d'un identifiant facial fourni.

-

SearchUsers- Pour effectuer une recherche auprès d'utilisateurs enregistrés à l'aide d'un identifiant facial ou d'un identifiant utilisateur fourni.

-

SearchUsersByImage- Pour effectuer une recherche parmi les utilisateurs enregistrés avec un visage à partir d'une image.

-

StartFaceSearch- Pour rechercher des visages dans une vidéo enregistrée.

-

CreateStreamProcessor- Pour rechercher des visages dans une vidéo en streaming.

Note

Les collections stockent des vecteurs de visages, qui sont des représentations mathématiques de visages. Les collections ne stockent pas d'images de visages.

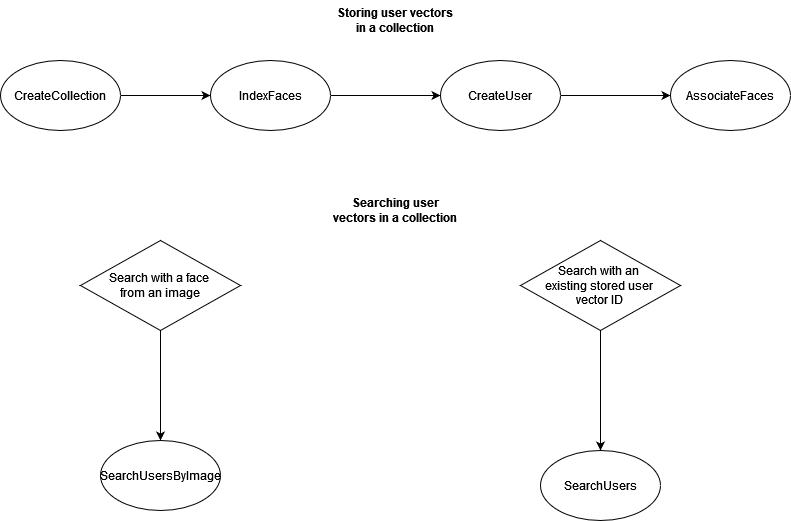

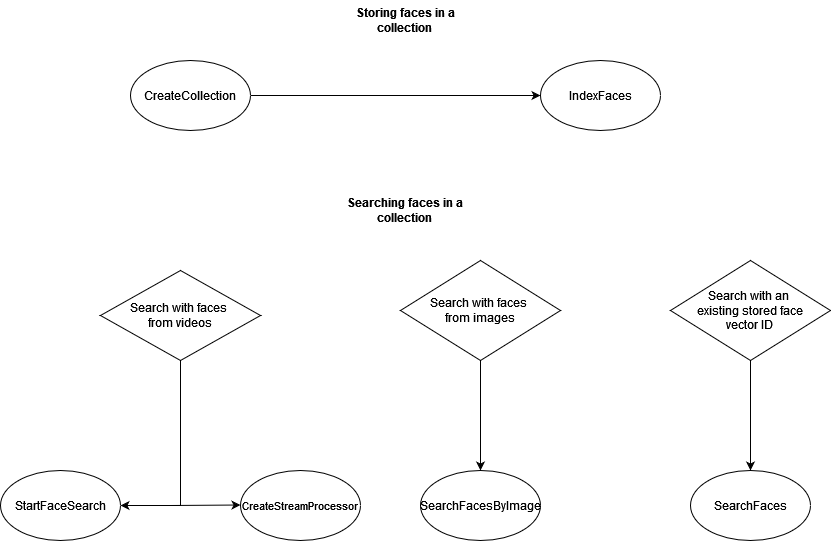

Les diagrammes suivants montrent l'ordre des opérations d'appel, en fonction de vos objectifs en matière d'utilisation des collections :

Pour une correspondance avec une précision maximale avec les vecteurs utilisateur :

Pour une correspondance de haute précision avec des vecteurs faciaux individuels :

Vous pouvez utiliser les collections dans différents scénarios. Par exemple, vous pouvez créer une collection de visages qui stocke les visages détectés à partir d'images de badges d'employés numérisées et de documents émis IDs par le gouvernement à l'aide AssociateFaces des opérations IndexFaces et. Lorsqu’un employé entre dans le bâtiment, une image du visage est capturée et envoyée à l’opération SearchUsersByImage. Si la correspondance des visages offre un score de similarité suffisamment élevé (par exemple, 99 %), vous pouvez authentifier l’employé.